衡宇 发自 凹非寺

总揽AI图像生成近10年的黄金程序,第一次被拉下场当了老师。

我说的是FID(Frechet Inception Distance)。

这个遐想从2017年沿用于今,一直无法无法进入普通熟练使用。

咫尺有东说念主冲破了这个逆境——

来自USC、CMU、CUHK和OpenAI的全华声势商讨团队,淡薄了一种叫FD-loss的程序,把“算统计的样本池”和“算梯度的batch”绝对解耦。

依靠数万张图像构成的大容量缓存队伍或指数挪动平均机制,雄厚完要素布估算,仅针对当下小批量数据开展梯度回传。

仅凭这一个idea,永久受限的FID终于概况算作熟练蚀本函数,参与模子的径直优化。

履行带来了多项出东说念主猜度的抑遏:

一个已有的单步生成器,后熟练后径直刷出FID 0.72(ImageNet 256×256),何况推理资本零增多。

一个熟练了50步的多步扩散模子,被他们径直repurposing成1步生成器,无需教师蒸馏、无需顽抗熟练,效果还能打。

其中最拒抗固有流露的发咫尺于,FID数值最优的模子,视觉不雅感偶而出众。依托DINOv2、MAE、SigLIP等前沿视觉表征熟练的模子,FID推崇不如基于Inception架构优化的版块,但画面物体结构完好意思性与细节收复度都会赫然更好。

业内永久扎堆优化FID分数,可这项沿用近十年的评价程序早已达到性能瓶颈,甚而会指导模子走入差错的优化标的。

对6种表征空间的归一化弗雷歇特距离(Fréchet Distance,FD)比值取平均,得到更鲁棒的轮廓遐想FDrk。

按照这套新程序测算,真正考证集基准数值为1.0,现阶段顶尖生成模子的数值依旧高达1.89。

这足以证实ImageNet图像生成领域,距离技巧老成还有很远的距离。

解耦统计量与梯度算计

FID是总计生成模子性能测评的中枢评判程序。

这个歌值越小,意味着生成图越真正、散布越接近真正。

它的算计神志是把真正图和生成图用Inception-v3提特征,各算一个高斯散布,再求两个散布之间的距离。

不外往日,FID只可当评测遐想。

因为测算一次FID需要50000张图片的统计数据,而GPU每步熟练能塞下的batch撑死也就1024张。

若是强行把5万样本一说念参与反向传播,显存多半就地爆炸。

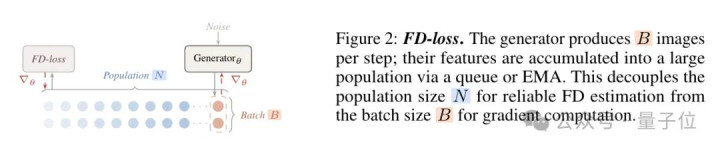

新商讨的破局想路是“绝对解耦”。

粗浅来说,商讨团队用数万张图构成的大窗口(队伍或 EMA)雄厚估算真正与生要素布的均值、协方差,保证FD算计准确;梯度只回传面前小批量数据,不增多熟练算力处事。

商讨者遐想了两种工程已毕。

第一种叫队伍法(Queue)。

这种程序调治一个超大特征队伍(比如5万条),每次生成新batch就enqueue,同期把最老的batch踢出去。

算FD时,用通盘队伍的均值和协方差;反向传播时,只给面前这1024条特征开梯度流,历史特征不参与梯度回传,保证统计庄重性的同期不增多熟练支拨。

第二种叫EMA法。

这种程序干脆不存储任何特征数据,仅通过指数挪动平均及时更腾达成样本特征的一阶矩与二阶矩,每一步使用面前批次的统计量平滑更新全局均值与协方差算计,梯度不异只作用于面前批次。

这种神志无需占用无数显存,统计抑遏更平滑雄厚,还能等满足配多表征空间结伙优化,在履行中推崇更优,也成为论文默许的已毕决议。

为了考证这套解耦机制是否果真有用,188金宝博官网app下载商讨者在最小的pMF-B/16(118M)上作念了两组消融履行。

(注:论文在履行中使用了明确的模子界限分级,其中B代表Base小模子,参数界限约89M到131M。)

第一组对比队伍长度。

无须队伍(N=0)时,FID反而从3.31劣化到3.84。

队伍加到5万时,FID骤降至0.89;但狂堆到50万后,因历史特征严重stale,FDr6径直崩回17.67。

第二组对比EMA衰减率。

β=0.999时,FID刷到0.81,比队伍版更优,且显耀好于过短的0.9(0.98)和过长的0.9999(0.98)。

因而后续总计履行——不管pixel/latent空间、多步转单步、如故2.5B参数的文本模子——均默许遴荐EMA决议。

三个“反知识”的履行发现

新淡薄的FD-loss本色上是一个后熟练的散布对都意见。

商讨者从仍是熟练好的生成器登程,只用FD-loss作念轻量微调。

真正图像只在离线阶段出现一次——事前把熟练集的均值和协方差算好存盘,之后模子再也不见真图,只对着我方生成的样本作念自我修正。

这意味着它不需要修改原有架构,不需要重新熟练,也不需要教师蒸馏或顽抗学习,像插件一样径直镶嵌现存过程。

何况不管像素空间如故隐空间、单步如故多步模子,都能即插即用。

有了这个轻量框架,商讨团队才得以系统性地测试当FID果真酿成蚀本函数,生成模子会发生什么。

FD-loss带来了三个伏击的履行发现。

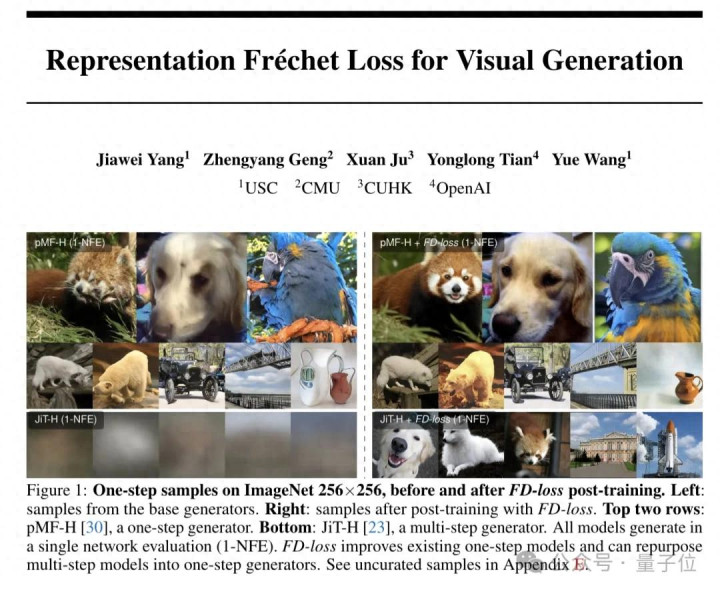

发现一,FD-loss让单步生成模子初度已毕画质与速率的新高度。

商讨者拿了一个仍是熟练好的单步生成器 pMF-H,径直上FD-loss微调100轮。

抑遏在ImageNet 256×256上,FID从2.29干到了0.77,同期依然保捏 1-NFE(单步生成)。

这一分数大幅越过过往多步扩散模子的最佳水平,北京pk10冲破了 “高质地必须多步、单步只可低画质” 的固有镣铐。

换句话说,推理资本一分钱没多花,画纯厚接跃升。

不异的操作放到latent-space的iMF-XL上,FID也从1.82压到0.76。

更要道的是,这种进步不是刷分。在论文图4的定性对比里,后熟练的鹦鹉羽毛更分明,雪豹的黑点也更明晰。

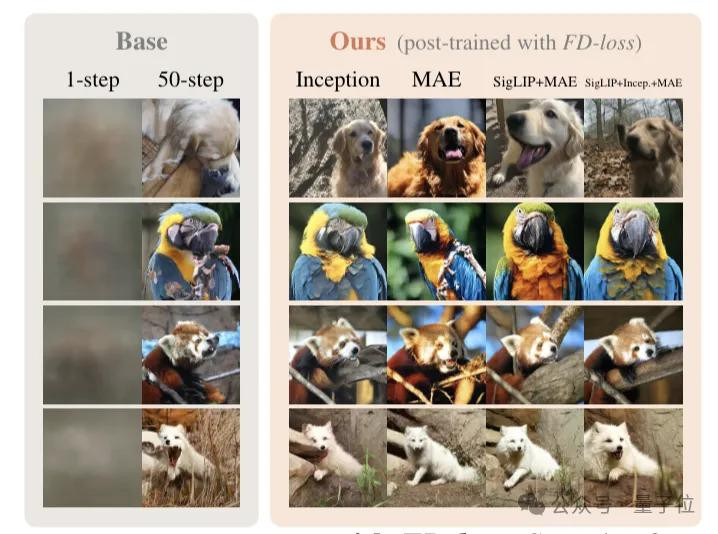

发现二,FD-loss不错径直将老成的多步扩散模子矫正为高性能单步生成器。

商讨者把原来熟练来跑50步的多步模子JiT-L,强行拉到单步形状,也即是径直输入纯噪声,模子只跑一次,输出就当最终图像。

抑遏即是FID径直崩到291.59,画面糊成一锅粥。

然后,他们什么都不改,就用FD-loss赓续微调这个的单步形状。

通盘过程无需教师蒸馏,无需顽抗熟练,无需逐样本监督信号。

50轮后,FID从291骤降到 0.77,生成质地与原多步模子相等甚而更优,何况推理速率进步数十倍。

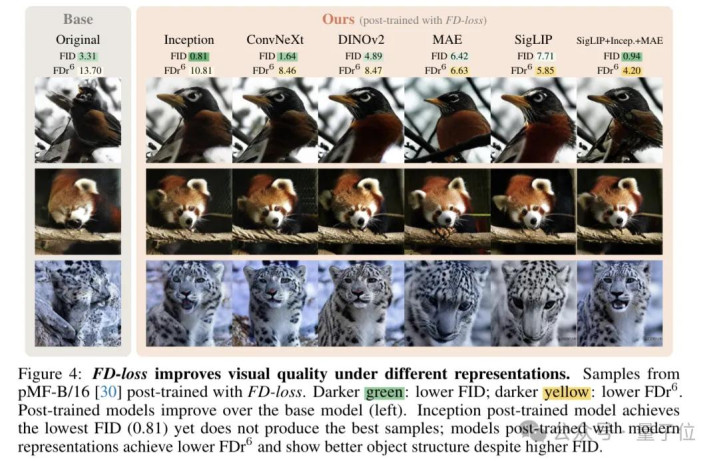

发现三,FID最低的,偶而是最佳的。

这亦然该历练最具行业反想价值的极少。

当商讨者把FD-loss放到不同的表征空间里优化时,事情变得诡异起来(惊惧.jpg)。

履行明晰标明,FID最低的模子,在东说念主眼主不雅评价中并非最优。

基于Inception特征优化的模子能取得最低FID,却在物体结构、细节纹理、合座感知上弱于使用DINOv2、MAE、SigLIP等当代视觉表征熟练的模子。

后者FID数值更高,但东说念主眼看更尖锐、物体结构更完好意思,视觉质地显耀更优。

这证实永久被奉为金程序的FID可能会误导商讨标的……

团队淡薄新程序

那么,若是FID仍是靠不住了,咱们拿什么来驯服生成模子的当先?

商讨团队淡薄跨6种表征空间的归一化平均遐想FDrk。

该遐想通过对Inception-v3、ConvNeXtv2、DINOv2、MAE、SigLIP2、CLIP共6种不同维度的表征空间算计归一化FD比值并取平均,得到轮廓评估抑遏FDr6。

按照这一程序,真正考证集的基准值为1.0,而面前最强生成模子的FDr6仍高达1.89,直不雅揭示 ImageNet生成任务远未被处理。

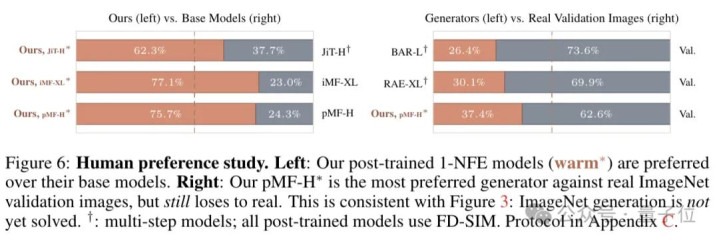

此外,在东说念主类盲选偏好履行中,即便最优的pMF-H模子,得票率也惟有37.4%,真正图片依旧以62.6%的胜率占优。

值得一提的是,FD‑loss具备极低的使用门槛与极强的泛化智商,可算作轻量化后熟练插件径直镶嵌现存熟练过程,无需从零搭建模子,也不依赖复杂的熟练战略与工程调优。

该程序同期兼容像素空间与隐空间生成模子,适配单步生成器与多步扩散模子,支柱类别条目生成与文生图等多种任务形状。

在通盘优化过程中,FD‑loss无需修改原有骨干汇齐集构,不引入复杂的架构篡改和重新熟练的弘大支拨,依托队伍或EMA统计更新即可雄厚照拂,具备优秀的复现性与落地可行性。

凭借简陋通用的遐想,它大幅镌汰了高质地极速生成模子的工程已毕门槛,让种种生成架构都能快速取得显耀的质地进步。

低资本、高酬报,这恰是FD-loss之于工业界的吸引力地方。

团队先容

公开信息披露,五位作家一说念是华东说念主配景。

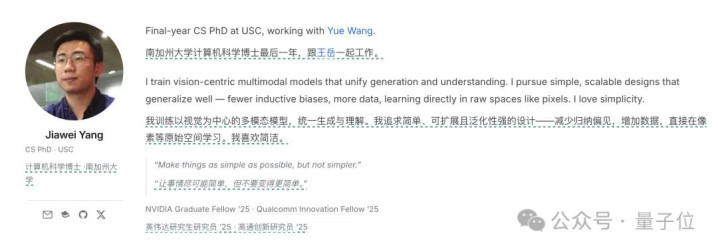

一作Jiawei Yang,USC算计机系博士生,师从Yue Wang老师,咫尺的商讨聚焦于以视觉为中心的多模态模子的调处生成与理会。

他硕士毕业于UCLA,曾获NVIDIA Graduate Fellowship。

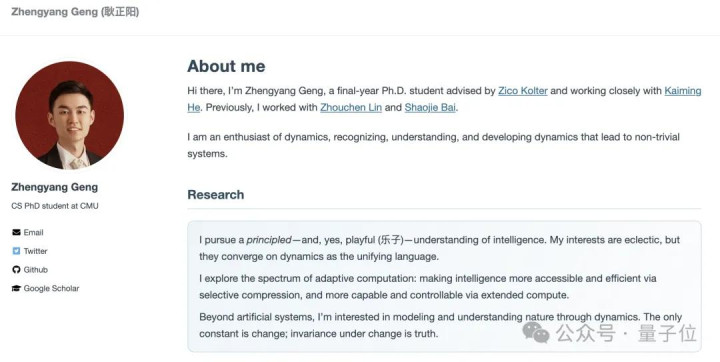

Zhengyang Geng本科毕业于四川大学算计金融专科,现为CMU算计机科学博士生,导师为Zico Kolter。

他永久专注单步生成、动态系统与模子高效化,是MeanFlow、pMF等系列处事中枢作家。

他的个东说念主主页写说念“与Kaiming He有详尽配合”,两东说念主曾引诱配合多篇单步生成领域中枢论文。

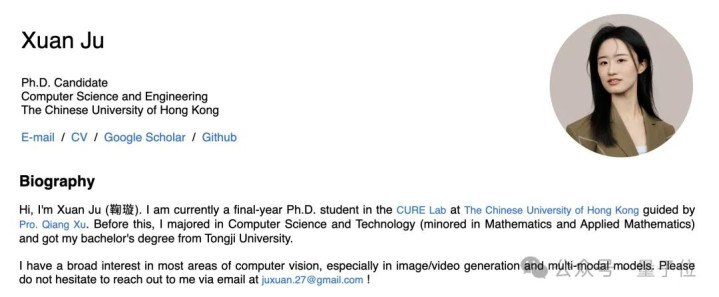

Xuan Ju是香港汉文大学博士生,师从徐强老师,主攻图像与视频生成、高效多模态模子。

她在ICCV、SIGGRAP 等顶会发表多篇效果。

Yonglong Tian博士毕业于MIT算计机科学专科,现为OpenAI商讨员。

他是监督对比学习SupContrast等表征学习标记性处事的作家,曾任职于Google DeepMind。

通信作家Yue Wang,USC助理老师,同期兼任英伟达商讨科学家。

他本科毕业于浙江大学,硕士毕业于UCSD,博士毕业于MIT,商讨横跨3D视觉、生成模子与机器东说念主。

论文arXiv:https://arxiv.org/abs/2604.28190

— 完 —

量子位 QbitAI · 头条号

关怀咱们北京pk10,第一时刻获知前沿科技动态

开运体育中国官网入口